Lebensläufe, Profile auf Plattformen wie LinkedIn, digitale Bewerbungstools und Videointerviews: Sie alle bilden im Jahr 2025 längst keine isolierten Elemente mehr. Sie verschmelzen zu einem einzigen datengetriebenen Ablauf. Unternehmen erfassen, verknüpfen und analysieren Datenpunkte aus unterschiedlichsten Quellen und bauen so umfassende digitale Bewerberprofile auf. Häufig bleibt aber den Bewerberinnen und Bewerbern verborgen, was tatsächlich gesammelt wird, wie es ausgewertet wird und welche Systeme Entscheidungen beeinflussen.

Von der Bewerbung zum digitalen Profil

Der Aufbau eines digitalen Bewerberprofils beginnt in der Regel mit dem Lebenslauf. Dieser wird über Karriereseiten oder Plattformen wie LinkedIn, XING oder Stepstone hochgeladen und häufig automatisiert von sogenannten CV-Parsing-Tools verarbeitet. Diese Systeme extrahieren relevante Daten wie Qualifikationen, bisherige Arbeitgeber und Schlüsselkompetenzen. Parallel dazu greifen viele HR-Tools auf öffentlich zugängliche Informationen zurück.

Applicant‑Tracking‑Systeme (ATS) sind darauf ausgelegt, alle Schritte des Bewerbungsprozesses nachvollziehbar zu erfassen: Sobald jemand eine Stelle bewirbt, übernimmt das ATS nicht nur seine Kontaktdaten und bisherigen Berufsverlauf, sondern speichert auch alle Status‑Änderungen wie Intervieweinladungen oder Absagen, Termine, Feedback und interne Notizen. Darüber hinaus werden diese Systeme von Personalverantwortlichen aktiv genutzt, um frühere Profile abzurufen, Gesprächsverläufe zu vergleichen oder vergangene Assessment‑Ergebnisse heranzuziehen – etwa wenn ein Kandidat erneut für eine Stelle in Betracht kommt.

Im Zentrum vieler moderner Bewerbungsverfahren stehen KI-gestützte Analysetools. Sie kommen bereits bei der Sichtung von Lebensläufen zum Einsatz und unterstützen HR-Abteilungen dabei, Bewerbungen nach festgelegten Kriterien zu sortieren. Neben dem reinen Abgleich von Qualifikationen können KI-Systeme auch Soft Skills, Sprachmuster und sogar die Struktur des Lebenslaufs analysieren.

Zunehmend werden auch Video-Interview-Tools verwendet, die Körpersprache, Mimik und Tonfall auswerten. Diese Systeme erstellen Scorings oder Empfehlungen, welche Talente für weitere Gespräche geeignet erscheinen. Die Daten, die im Rahmen dieser Analysen entstehen, werden oft in Talentpools gespeichert und können auch für zukünftige Auswahlprozesse genutzt werden. Laut den Regelungen des EU AI Act, der 2025 stufenweise umgesetzt wird, zählen solche Systeme zu den sogenannten Hochrisiko-KI-Anwendungen. Das bedeutet, dass sie strengen Anforderungen an Transparenz, Nachvollziehbarkeit und Diskriminierungsfreiheit unterliegen.

Datenschutz und Graubereiche

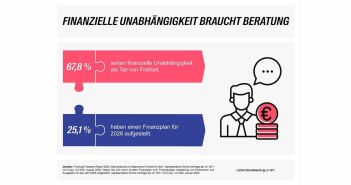

Überall wächst das Bewusstsein der Nutzer für die sichere Verwendung ihrer Daten – nicht nur im Bewerbungsprozess, sondern selbst in der digitalen Freizeitgestaltung. Viele Verbraucher achten 2025 deutlich stärker darauf, welche Daten sie preisgeben und wo diese landen. In der digitalen Unterhaltungsbranche zeigen dies unter anderem Streaming-Plattformen wie Netflix, die mit neuen Privacy-Optionen werben. Nutzer können Inhalte aus ihrem Verlauf ausblenden und so die Basis für Empfehlungen steuern.

Auch im Gaming gibt es entsprechende Entwicklungen: Epic Games beispielsweise hat Anfang 2025 seine Datenschutzrichtlinie aktualisiert und bietet den Nutzern mehr Kontrolle über Tracking- und Datennutzungsoptionen, inklusive Widerrufsrechten. Ein weiteres Beispiel sind Casinos ohne KYC, die in der iGaming-Branche an Popularität gewonnen haben. Hier registrieren sich Spieler ohne Angabe persönlicher Dokumente und Datenkontrollen fallen weg, was allerdings nur bei Anbietern mit Lizenzen aus bestimmten Regionen möglich ist.

Besonders in so sensiblen Bereichen wie Bewerbungsverfahren ist man aber rechtlich gut abgesichert. Die DSGVO garantiert das Recht auf Auskunft, Berichtigung, Löschung und Widerspruch gegen automatisierte Entscheidungen. Der EU Data Act sowie der AI Act erweitern diese Rechte. Unternehmen müssen ab 2025 offenlegen, wenn KI-gestützte Systeme an der Bewerberauswahl beteiligt sind, und die wesentlichen Entscheidungsgrundlagen solcher Systeme darlegen. Arbeitsuchende Menschen haben Anspruch darauf, die genutzte Logik nachvollziehen zu können.

Dennoch bestehen Graubereiche. Plattformen sichern sich in ihren Allgemeinen Geschäftsbedingungen häufig weitreichende Nutzungsrechte an den Daten, auch für KI-Training. Cookie-Tracking und App-Analysen finden oft ohne ausreichenden Hinweis statt. Besonders undurchsichtig bleibt die Praxis, Daten pseudonymisiert zwischen Plattformen und HR-Dienstleistern zu teilen, was rechtlich bislang kaum reguliert ist.

In vielen modernen Recruiting-Prozessen kommt es vor, dass Websites oder Apps Cookies platzieren, ohne dass Nutzer das direkt bemerken. Besonders persistent eingesetzt werden sogenannte Third‑Party‑Cookies, die das Surfverhalten sogar über verschiedene Seiten hinweg verfolgen können. Sie ermöglichen beispielsweise, dass Werbetreibende oder Plattformen erkennen, wann sich ein potenzieller Bewerber immer wieder bestimmte Stellen betrachtet oder gezielt auf bestimmte Jobs klickt – Informationen, die dann gesammelt und ausgewertet werden können.

Auch wenn viele große Browser aktuell Third‑Party‑Cookies einschränken, nutzen einige Anbieter weiterhin Techniken wie Browser-Fingerprinting oder zombie‑Cookies, um dieses Tracking fortzusetzen. Dass Kandidaten selten explizit darauf hingewiesen werden, liegt unter anderem an präsenten Cookie-Bannern, die oft nur pauschal auf „Tracking“ verweisen, aber keine selektive Einwilligung für unterschiedliche Zwecke ermöglichen.

Fairness und Bias

Automatisierte Systeme bergen das Risiko, unbewusst bestehende Diskriminierungen zu verstärken. Das kann sich etwa darin zeigen, dass bestimmte Sprachmuster, Bildungswege oder äußere Merkmale die Chancen mindern, ohne dass dies objektiv gerechtfertigt wäre. Der EU AI Act wird ab 2025 stufenweise umgesetzt. Er sieht für hochriskante Systeme wie HR-KI verpflichtende Bias-Prüfungen vor, deren verbindliche Anwendung mit der Vollumsetzung ab 2026 erwartet wird.

Quellen:

- https://eur-lex.europa.eu/legal-content/DE/TXT/?uri=CELEX:32021R0813

- https://eur-lex.europa.eu/eli/reg/2023/2854/oj

- https://eur-lex.europa.eu/legal-content/DE/TXT/?uri=CELEX:32016R0679

- https://edpb.europa.eu/system/files/2023-12/edpb_guidelines_6_2023_third-party_cookies_fingerprinting_de.pdf

- https://www.privacyinternational.org/explainer/4455/google-and-apple-gather-data-through-browser-fingerprinting

- https://business.linkedin.com/talent-solutions/recruiter-system-connect

- https://www.hirevue.com/platform

- https://www.modernhire.com/product/ai-assessment/

- https://help.netflix.com/en/node/264

- https://newsroom.netflix.com/de-de/2024/12/01/einstellungen-zu-empfehlungen

- https://www.tomsguide.com/how-to/this-hidden-netflix-trick-hides-what-youve-been-watching

- https://www.epicgames.com/site/en-US/privacypolicy

- https://dev.epicgames.com/docs/epic-account-services/consent-management

- https://www.reuters.com/legal/microsofts-linkedin-sued-disclosing-customer-information-train-ai-models-2025-01-22/

- https://www.edpb.europa.eu/news/news/2025/edpb-adopts-pseudonymisation-guidelines-and-paves-way-improve-cooperation_de

- https://apnews.com/article/6769ae3b83ea0d83cab8d8cfd1fa7e68

- https://www.reuters.com/legal/linkedin-lawsuit-over-use-of-customer-data-ai-models-is-dismissed-2025-01-31/

- https://www.euronews.com/next/2024/10/24/irish-watchdog-slaps-linkedin-with-310m-fine-for-gdpr-violations

- https://privacy.blog.fordham.edu/linkedin-accused-of-using-private-messages-to-train-ai-models/

- https://www.dataprotection.ie/en/news-media/press-releases/irish-data-protection-commission-fines-linkedin-ireland-eu310-million